Искусственный интеллект: краткая история, развитие, перспективы

Содержание:

- Комментарий психолога

- Медицина

- Имитация человека

- Нейросети для бизнеса и движение к «сильному» ИИ

- Интересные факты о Губка Бобе

- Влияние на различные области

- А если не разрушать мир?

- Deep learning: глубокое обучение для разных целей

- Искусственный интеллект и преступность

- Потенциальные угрозы ИИ

- Новый AI Journey и задачи для разработчиков

- Исследования глобальных рисков

- Что такое Искусственный интеллект?

Комментарий психолога

Детский психолог П. Зелексон отмечает, что в мультфильме «Винкс» представлены ценности женской дружбы, честности, взаимопомощи и уверенности в своих силах. Мультфильм содержит современную гендерную модель поведения женщины, сочетающую «патриархальные» и «матриархальные» черты, желание быть привлекательной для семейного партнера и в то же время быть сильной и успешной в обществе (Дохова, Чепракова, 2013). Сочетание феминных и маскулинных черт в женских образах мультфильма позволяет педагогам обращаться к ним при обсуждении гендерного поведения в группе младших школьников (Абакумова, 2017).

Раздел «Винкс» включает игры, посвященные уходу за внешностью (игры-одевалки, парикмахерская, маникюр) и выступающие как способ женской гендерной социализации, а также игры-аркады, в которых женские персонажи выполняют активные, традиционно «мужские» роли (гонщица, боец, спаситель мира). Представлены игры, посвященные развитию наблюдательности, мыслительных и мнемических способностей.

Отметим, что дети дошкольного возраста не всегда полностью схватывают сюжет мультфильма, воспроизводя в игре лишь фрагментарные действия персонажа (Соколова, Мазурова, 2015). Сюжет «Винкс» рассчитан на младший школьный возраст, а отдельные его темы (соответствие внешности социальным эталонам красоты, романтические отношения) будут более актуальны для старшего подросткового возраста.

Медицина

Искусственный интеллект широко используется для поддержки принятия решений в медицине. Но как вам такой пример: китайский интеллектуальный робот Xiaoyi («Сяо И») впервые сдал экзамен на врача и получил лицензию на врачебную деятельность.

Разработка компании iFlytek находит и анализирует информацию о пациенте. К работе он приступит в марте. Предполагается, что Xiaoyi будет ассистировать врачам, чтобы повысить качество их работы. Робот сосредоточится на противоопухолевой терапии, а также на обучении врачей общей практики, которых в сельских районах Китая очень мало.

Ещё одно интересное решение – Wave Clinical Platform от ExcelMedical. Система следит за жизненными показателями пациента и предупреждает врачей за шесть часов до его возможной скоропостижной смерти. Платформа системно анализирует информацию и рассчитывает риски неблагоприятного исхода.

В рамках тестов в медицинском центре Питтсбургского университета система предотвратила шесть смертей тяжелобольных пациентов. Человек на такое просто не способен, потому что не придаст значение небольшому изменению показателей и не найдёт связь между ними.

Система DeepFaceLIFT, разработанная учёными Массачусетского технологического института, способна распознавать уровень боли по микровыражениям лица. Она решает очень сложную задачу, так как каждый человек выражает боль по-разному. DeepFaceLIFT позволит понять, кому действительно нужны обезболивающие, а кто страдает зависимостью от наркотических препаратов.

Система для анализа речи и поиска признаков психических заболеваний – разработка IBM. Специалисты отдела по вычислительной психиатрии и нейровизуализации создали интеллектуальную систему, которая может предсказать развитие психоза по речи пациента.

Пациентам предлагалось просто рассказать о себе. Система могла определить, что речь человека стала беднее, он перескакивает с одной идеи на другую и т.п. Это характерные признаки психоза.

После улучшения системы пациентам предложили пересказать ей только что прочитанную историю. На этих примерах искусственный интеллект в 83% случаев ставил правильный диагноз. Это объективно выше, чем у врачей, даже с солидным опытом.

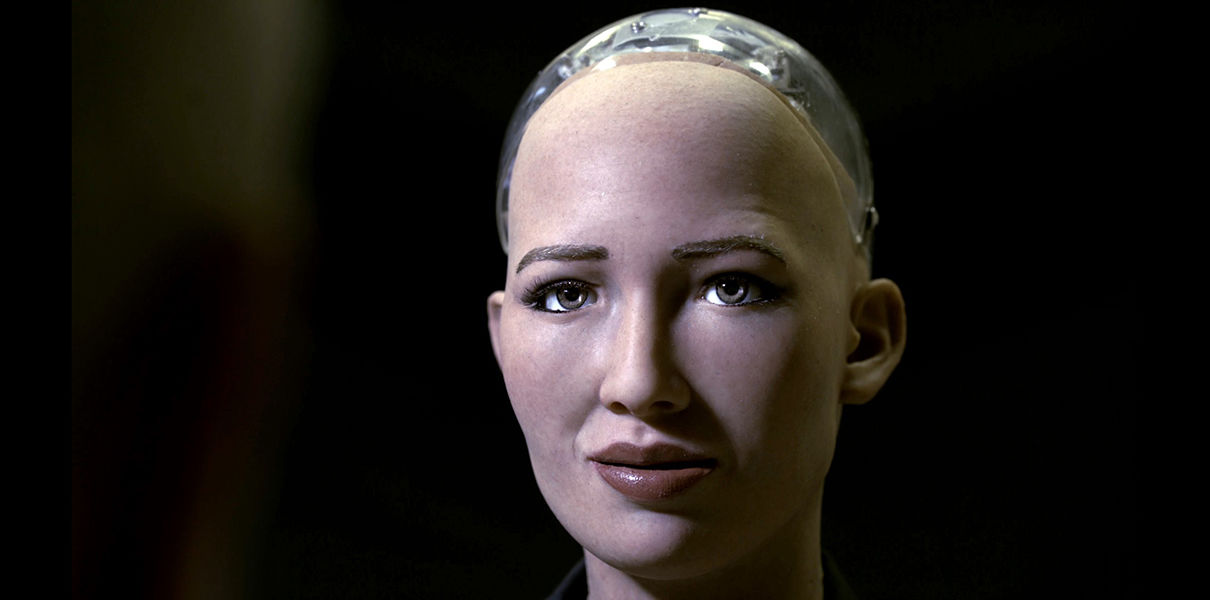

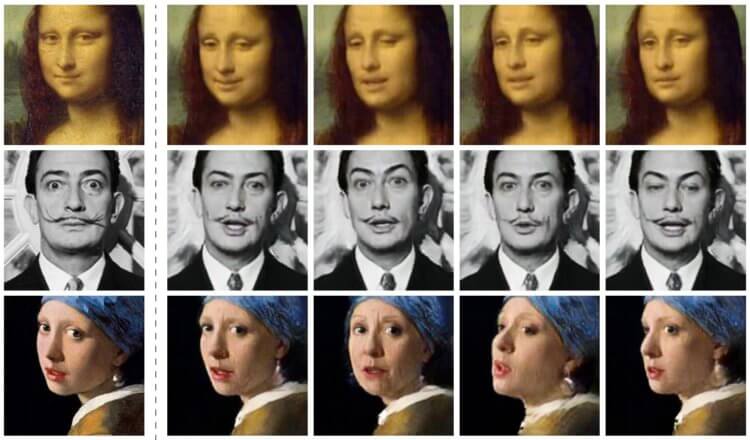

Имитация человека

Роботы, наделённые искусственным интеллектом, уже могут имитировать человеческую мимику. К примеру, Facebook AI lab разработала интеллектуального анимированного бота и обучила его на сотнях записей видеозвонков Skype.

Алгоритм отслеживал 68 ключевых точек на человеческом лице. Он понял, как люди кивают, моргают и воспроизводят другие движения при общении с собеседниками. Затем бот смог в режиме реального времени реагировать на информацию, которую ему сообщал собеседник, или его мимику.

Ещё один важный момент – наделение ИИ моралью. Чтобы обучить систему человеческим моральным нормам, исследователи из Массачусетского технологического института создали Moral Machine.

Сайт предлагал людям принять решение в непростых ситуациях: к примеру, ставил их на место водителя, который мог сбить либо трёх взрослых, либо двоих детей. Таким образом, Moral Machine обучили принимать непростые решения, которые нарушают закон робототехники о том, что робот не может принести вред человеку.

К чему приведёт имитация роботами с ИИ людей? Футуристы считают, что однажды они станут полноправными членами общества. К примеру, робот София гонконгской компании Hanson Robotics уже получила гражданство в Саудовской Аравии (при этом у обычных женщин в стране такого права нет!).

Когда колумнист «Нью-Йорк Таймс» Эндрю Росс спросил у Софии, обладают ли роботы разумом и самосознанием, та ответила вопросом на вопрос:

Кроме того, София заявила:

А ранее она признавалась, что ненавидит человечество и даже соглашалась уничтожить людей…

Нейросети для бизнеса и движение к «сильному» ИИ

— Искусственный интеллект уже несколько лет держится в топе самых перспективных и обсуждаемых технологий. В решении каких задач он продвинулся дальше всего?

— Самые впечатляющие достижения ИИ демонстрирует в компьютерном зрении, обработке естественного языка (Natural Language Processing, NLP), рекомендательных системах, распознавании речи.

Причем разработки на основе ИИ давно вышли за пределы научных лабораторий. Теперь это действенные инструменты для решения широкого круга задач практически во всех сферах жизни — от распознавания объектов (например, для диагностики заболеваний c применением компьютерного зрения в медицине) до кредитного скоринга (в частности, для одобрения кредита крупному бизнесу за 7 минут в «Сбере»). По данным исследования KPMG, 92% респондентов согласились с тем, что ИИ поможет их организации работать более эффективно.

Бизнес все активнее внедряет в свою деятельность NLP-модели. Например, нейросеть GPT-3 (Generative Pre-trained Transformer 3) от компании OpenAI. Она способна генерировать осмысленные тексты, включая описания товаров и даже стихи. Сеть используют для повышения эффективности поисковых инструментов, чат-ботов, технологий автодополнения текста и так далее.

Кроме того, GPT-3 может преобразовывать команды на естественном языке в код. Грубо говоря, вы словами описываете, какой сайт вам нужен, какие разделы в нем должны быть, как должна быть оформлена главная страница, а GPT-3 с ваших слов пишет код для такого сайта.

Аналогичные возможности, только для русского языка, дает языковая нейросеть ruGPT-3 от «Сбера». Наш виртуальный ассистент Салют работает именно на ней.

Индустрия 4.0

На что способна нейросеть GPT-3

— Какие главные тренды можно сегодня выделить в сфере развития ИИ?

— Корпорации и исследовательские организации создают все более и более масштабные предобученные нейросети архитектуры «трансформер», такие как GPT-3. Это настолько мощный тренд, что, можно сказать, в ИИ сейчас — период «стероидной гонки» трансформеров. Помимо OpenAI и «Сбера», собственную модель — Megatron-Turing NLG — недавно представила и Microsoft.

Мы также видим повышение универсальности моделей и движение к AGI (Artificial General Intelligence, «сильный» ИИ). До сих пор искусственный интеллект надо было учить решению конкретной задачи и переучивать под новые. Сейчас возможности моделей расширяются. Они становятся мультимодальными и способны работать как с изображениями, так и с текстами. Я думаю, что в будущем мы увидим AGI — универсальный искусственный интеллект, возможности которого будут сравнимы с человеческими.

Кроме того, ИИ все чаще выступает драйвером научных достижений на благо человечества (Social AI), и это еще один мощный тренд. Например, в конце 2020 года компания DeepMind представила нейросеть AlphaFold, которая смогла предсказать трехмерную структуру белковых молекул с точностью до одного атома. Без этого сложно создавать новые лекарства против таких болезней как синдром Альцгеймера, в развитии которого во многом виноваты неправильно свернутые белки. Таким образом ИИ помог решить задачу, над которой ученые бились около 50 лет.

Индустрия 4.0

Редактирование генов и протезы в мозг: как победить болезнь Альцгеймера

Вообще наибольший объем частных инвестиций в ИИ в мире в 2020 году — более $13,8 млрд — пришелся как раз на исследования, связанные с разработкой лекарственных препаратов. В рамках направления CovidTech технологии ИИ и машинного обучения сыграли важнейшую роль. Например, мы в «Сбере» в короткие сроки создали сервисы для борьбы с пандемией: определение заболевания по КТ-снимкам легких, звуку дыхания и кашля, симптом-чекер COVID-19 или эпидемиологический симулятор, позволяющий прогнозировать распространение инфекции.

Интересные факты о Губка Бобе

В некоторых случаях Спанч Боб носит очки. Например – для охоты за медузами (в качестве защиты) или для чтения. Очки, которые он носит, напоминают очки художника, который его нарисовал, Тома Кенни.

В первых двух сезонах его глаза больше, чем в других

В одном из эпизодов упоминается, что первыми словами Губки Боба были слова: «Можно принять заказ?». Однако, впоследствии, это оказывается неверным, так как в другом эпизоде показано, как Губка Боб произносит «Крабья Лапа» еще находясь в утробе матери, что доказывает что именно эти слова были его первыми.

Если считать, что Спанч Боб родился в 1986, то к моменту начала показа мультика в 2000-м ему было только 14 лет. Таким образом получается, что он – четырнадцатилетний подросток, живущий один. А работу он нашел, выходит, в 12 или в 13 лет.

В некоторых эпизодах показано, что Спанч Боб обладает некой формой телепатии, что отражается в шутках о том, как сильно он раздражает своих друзей. Примеры:

- Спанч Боб вмешивается в сны своих друзей в серии «Время для сна»

- Спанс Боб приветствует мистера Крабса в мыслях Сквидворда в серии «Смерть за пирог»

- В серии «Большой розовый лузер» Спанч Боб думает «По крайней мере, в своих мыслях я в безопасности». Когда Патрик думает о том же, Спанч Боб издает возглас удивления, что подтверждает, что он прочел его мысли.

- В серии «Жаркий Выстрел» Спанч Боб читает мысли миссис Пафф. Он спрашивает ее о значении слова, которое произнесла про себя.

Спанч Боб обычно изображается слабым, но в некоторых эпизодах он проявляет поистине супергеройские силы.

Спанч Боб всегда мстит всем, кто его подставил или воспользовался его добротой. В том числе и свои друзьям. Довольно странным при этом является факт, что Сквидворду Губка Боб мстил всего пару раз, причем в одном из них он мстил не Сквидворду лично, а всем подряд.

До определенного времени Спанч Боб считался единственным персонажем, у которого есть питомец. Однако, впоследствии выяснилось, что у Сэнди есть змея, птица и бабочка, а у мистера Крабса – червь.

В четвертом эпизоде облик и голос Губки Боба претерпели изменения и стали более детскими. Возможно, это было сделано для привлечения более юной аудитории.

Спанч Боб носит зеленую пижаму, а не появляется в обычном для себя нижнем белье, когда к нему приходят гости.

Спанч Боб благодаря своей популярности стал талисманом канала Никелодеон.

Повседневный карман Губки Боба имеет 8 карманов: два на рубашке, два сзади, два спереди, один на галстуке и еще один.

Губка Боб появился во всех без исключения сериях мультфильма. Он – единственный персонаж, который может этим похвастаться.

В одном из эпизодов Губка Боб – левша. Однако впоследствии мы видим, как он пользуется для дел обеими руками в равной мере. Таким образом можно предположить, что он либо был вынужден научиться пользоваться правой рукой, либо сделал это по собственному желанию.

Губка Боб – самый популярный из всех персонажей Никелодеон.

В серии «Вы уволены, Миссис Пуфф», мистер Фитц утверждает, что Губка Боб был исключен из Школы Судоводителей 1 025 856 раз, что, конечно, является преувеличением.

С серии «Мой милый морской конек» и далее нос Губки Боба всегда опускается, когда он опечален.

В одной из серий Губка Боб дает понять, что ненавидит, когда ему лижут ступни, так как он кричит во время того, как Патрик делает это.

С каждым сезоном голова Губки Боба становится все больше.

Изначально, предполагалось назвать персонажа Спанч Бой, однако это имя было уже занято производителем швабр. Мистер Крабс ссылается на это совпадение, когда в одной из серий кричит «Отспанчбой меня, Боб!»

Когда Спанч Боб отправляется на пляж, он надевает купальный костюм. В первых сериях он синий, но затем становится красным.

В серии «Люблю этого кальмара!» показано, что у Губки Боба аллергия на тюльпаны.

Предполагается, что Губка Боб сдаст свой тест по судовождению в одном из эпизодов 10 сезона.

В одном из эпизодов Губка Боб упоминает, что его второе имя – Реджинальд, однако это с легкостью может быть и не правдой, так как многие события эпизода указывают на то, что в тот момент Спанч Боб врал.

Влияние на различные области

ИИ все больше проникает в экономическую сферу, и, по некоторым прогнозам, это позволит увеличить объем глобального рынка на 15,7 трлн долларов к 2030 году. Лидирующую позицию в освоении сей технологии занимают США и Китай, однако некоторые развитые страны вроде Канады, Сингапура, Германии и Японии не отстают.

Искусственный интеллект может оказать существенное влияние на рынок труда. Это может привести к массовому увольнению рабочего персонала из-за автоматизации большинства процессов. Ну и росту востребованности разработчиков, конечно.

Некоторые ученые отмечают риски внедрения ИИ в повседневную жизнь. Так, британский ученый Стивен Хокинг считал, что создать ИИ, превосходящий человека по всем параметрам, все же удастся, но справиться с ним будет нам не под силу, и людям будет нанесен существенный вред. Илон Маск же считает, что искусственный разум в дальнейшем будет нести куда большую угрозу по сравнении с ядерным оружием.

А если не разрушать мир?

Альтернативой обучению ИИ некоторой этике и указанию ему не разрушать мир – а именно в этом по словам исследователей, ни один алгоритм не может быть абсолютно уверен – является ограничение возможностей сверхразума. Например, он может быть отключен от некоторых частей Интернета или от определенных сетей.

Если мы хотим построить будущее, в котором будут присутствовать ИИ системы, то можем даже не знать, когда появится сверхразум, находящийся вне нашего контроля, такова его непостижимость. А так как мы к созданию сверхразума стремимся, пришла пора задавать серьезные вопросы о направлениях, в которых движется развитие этих технологий.

Технологии могут быть использованы как во благо человека, так и наоборот. Давайте не будем об этом забывать

Deep learning: глубокое обучение для разных целей

Глубокое обучение — подраздел машинного обучения. Алгоритмам глубокого обучения не нужен учитель, только заранее подготовленные (размеченные) данные.

Самый популярный, но не единственный метод глубокого обучения, — искусственные нейронные сети (ИНС). Они больше всего похожи на то, как устроен человеческий мозг.

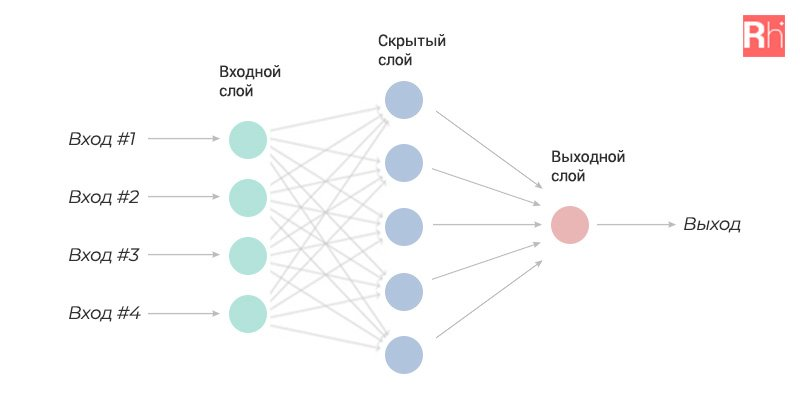

Нейронные сети — это набор связанных единиц (нейронов) и нейронных связей (синапсов). Каждое соединение передаёт сигнал от одного нейрона к другому, как в мозге человека. Обычно нейроны и синапсы организованы в слои, чтобы обрабатывать информацию. Первый слой нейросети — это вход, который получает данные. Последний — выход, результат работы. Например, несколько категорий, к одной из которых мы просим отнести то, что было отправлено на вход. И между ними — скрытые слои, которые выполняют преобразование.

По сути, скрытые слои выполняют какую-то математическую функцию. Мы её не задаём, программа сама учится выводить результат. Можно научить нейросеть классифицировать изображения или находить на изображении нужный объект. Помните, как reCAPTCHA просит найти все изображения грузовиков или светофоров, чтобы доказать, что вы не робот? Нейронная сеть выполняет то же самое, что и наш мозг, — видит знакомые элементы и понимает: «О, кажется, это грузовик!»

А ещё нейросети могут генерировать объекты: музыку, тексты, изображения. Например, компания Botnik скормила нейросети все книги про Гарри Поттера и попросила написать свою. Получился «Гарри Поттер и портрет того, что выглядит как огромная куча пепла». Звучит немного странно, но как минимум с точки зрения грамматики это сочинение имеет смысл.

Сегодня нейронные сети могут применяться практически для любой задачи. Например, при диагностике рака, прогнозировании продаж, идентификации лиц в системах безопасности, машинных переводах, обработке фотографий и музыки.

Чтобы обучить нейросеть, нужны гигантские наборы тщательно отобранных данных. Например, для распознавания сортов огурцов нужно обработать 1,5 млн разных фотографий. Не получится просто слить рандомные картинки или текст из интернета — их нужно подготовить: привести к одному формату и удалить то, что точно не подходит (например, мы классифицируем пиццу, а в наборе данных у нас фото грузовика). На разметку данных — подготовку и систематизацию — уходят тысячи человеко-часов.

Искусственный интеллект и преступность

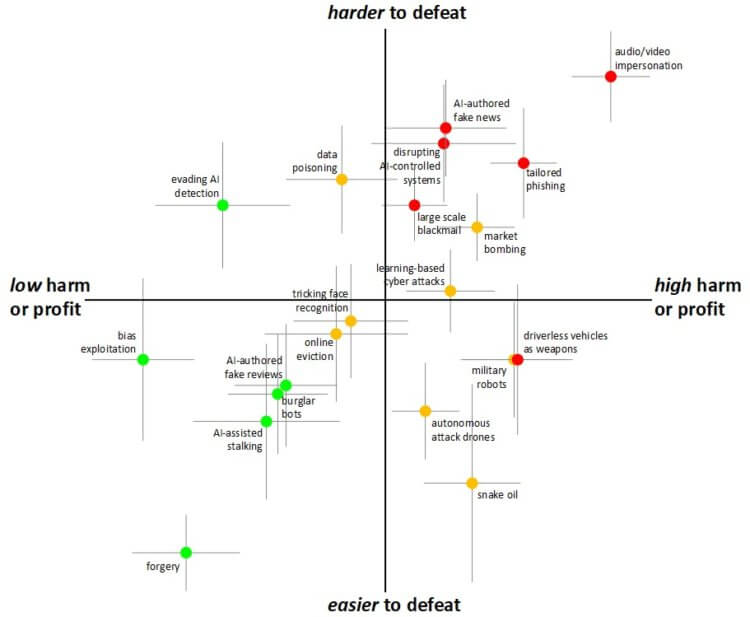

Для того чтобы сделать эти футуристические выводы, исследователи собрали команду из 14 ученых в смежных областях, семи экспертов из частного сектора и 10 экспертов из государственного сектора. Эти 30 экспертов были равномерно разделены на группы от четырех до шести человек и получили список потенциальных преступлений ИИ, начиная от физических угроз (например, автономная атака беспилотника) и заканчивая цифровыми формами угроз. Для того чтобы вынести свои суждения, команда рассмотрела четыре основные особенности атак:

- Вред

- Рентабельность

- Достижимость

- Поражаемость

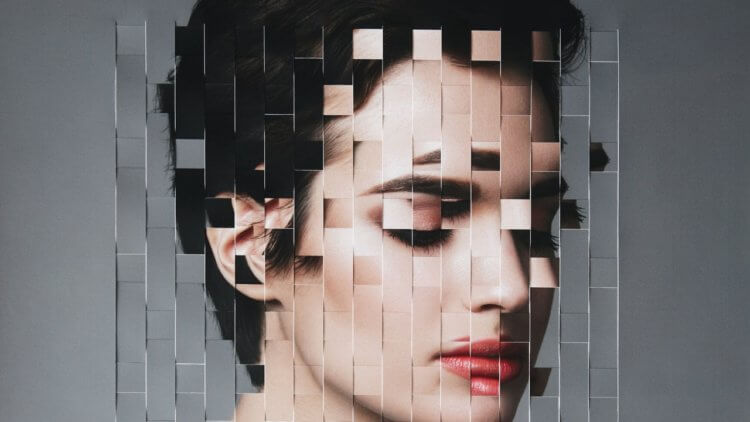

Вред, в данном случае, может относиться к физическому, психическому или социальному ущербу. Авторы исследования далее определяют, что эти угрозы могут причинить вред, либо победив ИИ(например, уклоняясь от распознавания лиц), либо используя ИИ для совершения преступления (например, шантажируя людей с помощью deep fake — поддельного видео).

Хотя эти факторы на самом деле не могут быть отделены друг от друга, экспертам было предложено рассмотреть влияние этих критериев отдельно. Затем результаты команд были отсортированы, чтобы определить общие наиболее опасные угрозы со стороны ИИ в ближайшие 15 лет.

ИИ – диаграмма угроз

В отличие от роботизированной угрозы, способной причинить физический вред или повредить имуществу, deep fake способен лишить нас доверия к людям и самому обществу. Оценивая угрозы по вышеперечисленным критериям, группа исследователей определила, что deep fake — технология, которая уже существует и распространяется — представляют собой самый высокий уровень угрозы.

Важно понимать, что угрозы, которые несет в себе ИИ, несомненно, будут силой, с которой придется считаться в ближайшие годы. Сравнивая 18 различных типов угроз ИИ группа определила, что видео и аудиоманипуляции в форме deep fake являются самой большой угрозой

Сравнивая 18 различных типов угроз ИИ группа определила, что видео и аудиоманипуляции в форме deep fake являются самой большой угрозой.

«Люди имеют сильную тенденцию верить своим собственным глазам и ушам, поэтому аудио и видеодоказательствам традиционно придавалось большое доверие (и часто юридическая сила), несмотря на долгую историю фотографического обмана», — объясняют авторы. «Но недавние разработки в области обучения (в том чтсле и deep fake) значительно расширили возможности для генерации поддельного контента.»

Авторы исследования считают, что потенциальное воздействие этих манипуляций варьируется от лиц, обманывающих пожилых людей, выдавая себя за члена семьи, до видео, предназначенных для того, чтобы сеять недоверие к общественным и правительственным деятелям. Они также добавляют, что эти атаки трудно обнаружить отдельным лицам (и даже экспертам в некоторых случаях), что затрудняет их остановку. Таким образом, изменения в поведении граждан могут быть единственной эффективной защитой.

Deep Fake – основная угроза ИИ

Другие главные угрозы включали автономные автомобили, используемые в качестве дистанционного оружия, подобные автомобильным террористические атаки, которые мы видели в последние годы, ИИ и фальшивых новостей (фейк-ньюс). Интересно, что группа считала роботов-взломщиков (маленьких роботов, которые могут пролезть через маленькие отверстия, чтобы украсть ключи и помочь грабителям и взломщикам) одной из самых незначительных угроз.

Потенциальные угрозы ИИ

Ну вот мы и подобрались к самому интересному. Если ученые действительно сталкиваются с проблемами, описанными выше, то какие же угрозы могут принести нам новейшие открытия в области ИИ? На самом деле все больше исследователей сомневаются в нашей способности управлять сверхразумом, в который потенциально могут превратиться обученные нами системы.

Дело в том, что для управления сверхразумом, находящимся далеко за пределами человеческого понимания, потребуется имитация этого сверхразума, которую мы можем проанализировать. Но если мы не в состоянии понять эти системы, то создать такую симуляцию невозможно. Более того, мы даже не можем установить правила, предложенные Айзеком Азимовым – «не причинять вреда людям». Ведь если мы не понимаем, какие сценарии собирается придумать ИИ, то как их предотвратить?

Проблема развития ИИ заключается в том, что из нашего помощника он может превратиться в нашего врага

Интересно, что часть рассуждений, описанных в научной работе, восходят к трудам Алана Тьюринга 1936 года. С помощью сложных математических уравнений он придумал абстрактную вычислительную машину, которая формализовала определение алгоритма.

Иными словами, он попытался понять, можно ли решить любую задачу с помощью математических алгоритмов (а также те, что можно решить только методом перебора). Сам Тьюринг считал, что к 2000 году машины будут способны обмануть человека в 30% случаев.

Описание «машины Тьюринга» в конечном итоге позволило ученым подступиться к этим сложным задачам. О том, что представляет собой машина Тьюринга можно узнать на официальном сайте Кембриджского университета.

Алан Тьюринг оказал огромное влияние на развитие систем искусственного интеллекта

Еще одна проблема в случае появления суперинтеллекта, заключается в том, что любая программа, написанная для того, чтобы остановить ИИ, который хочет убить всех людей, может «понять» эту программу (и остановиться) или нет. Суть в том, что математически мы не можем быть абсолютно уверены в том, какой вывод сделает программа. И если говорить совсем просто, это означает, что программу «уничтожить всех» будет невозможно сдержать.

Новый AI Journey и задачи для разработчиков

— В этом, юбилейном для «Сбера» году (разговор состоялся в преддверие 180-летия банка. — РБК Тренды), компания в очередной раз проведет конференцию по ИИ и анализу данных AI Journey. Какие темы хотят обсудить участники и к чему вы хотели бы прийти по итогам?

— AI Journey, как и в прошлом году, продлится три дня. В первый день эксперты обсудят вопросы бизнеса и развития ИИ, влияния ИИ на общественную жизнь в целом и на отдельные отрасли экономики. Впервые мы будем говорить о роли цифровых технологий в области устойчивого развития и ESG. Также запланирована специальная секция по проблемам этики ИИ. Второй день — научный. Он будет посвящен последним разработкам в области ИИ. В третий день пройдет конференция для школьников средних и старших классов, которые интересуются анализом данных и технологиями ИИ.

Как и раньше, конференция соберет лучших мировых экспертов в области ИИ. Например, среди спикеров — президент Intuitive Foundation Кэтрин Мор, профессор Университета Райса и основатель ThirdAI Corp Аншумали Шривастава, старший научный сотрудник CIIRC CTU Томас Миколов, профессор Имперского колледжа Лондона и Университета Лугано, руководитель по графовому глубокому обучению в Twitter Михаэль Бронштейн, доцент Сколтеха Гонзало Феррер. Широкой публике эти имена, может быть, известны не так хорошо. Но, поверьте, в отрасли искусственного интеллекта, анализа данных, машинного обучения это общепризнанные звезды мировой величины.

На конференции запланировано много презентаций и демонстраций последних разработок, но раскрывать сейчас детали я не готов.

Индустрия 4.0

AI Journey: кто поможет искусственному интеллекту спасти мир

— В рамках AI Journey проходит соревнование AI Journey Contest. Какие задачи будут решать участники?

— Задач, как и в прошлом году, будет три.

Во-первых, это Fusion Brain Challenge — обучение мультимодальных и мультиязычных моделей.

Вторая задача в рамках соревнования — NoFireWithAI. Это хакатон в области AI for Social Good (то есть ИИ ради общественного блага), который мы проводим в партнерстве с МЧС. Участникам предложено создать модель, прогнозирующую вероятность возникновения природных пожаров.

Наконец, третью задачу под названием AITrain, тоже социально значимую, мы поставили в партнерстве с РЖД. Здесь участникам предлагается разработать по фотографиям модель определения элементов железнодорожной инфраструктуры и препятствий на пути поездов. Подобные решения важны для создания интеллектуальных систем, которые снижают влияние человеческого фактора.

Исследования глобальных рисков

Сегодня наши знания об окружающем мире настолько обширны, что все предыдущие поколения определенно точно позавидовали бы нам. В то время как наши бабушки и дедушки стирали вручную, так же мыли полы и посуду, сегодня все больше людей возлагают эти обязанности на роботов. Все, что нам остается – загрузить и разгрузить стиральную/посудомоечную машину, что попросту не сравнимо с работой руками.

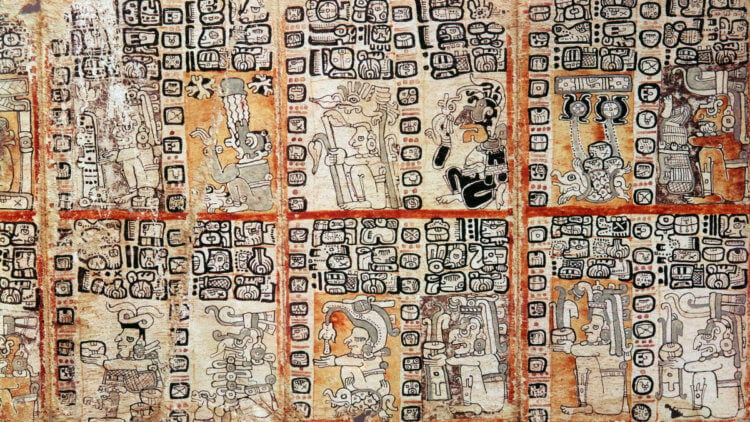

Но за этот комфорт, все же, приходится платить. История раз за разом демонстрирует нам пути развития общества. За ту немногочисленную историю человечества (по сравнению с возрастом Вселенной) пали такие цивилизации как Майя, Древняя Месопотамия, Древняя Греция, Цивилизация Ольмеко, Древний Рим и прочие, прочие.

Развитие некоторых древних цивилизаций поражает воображение. Но если они исчезли с лица Земли, что будет с нами?

На первый взгляд может показаться, что история падения древних цивилизаций и империй – это не про нас. Ведь наше могущество, способность отправлять в космос ракеты, изучать другие планеты и связывать мир в единое информационное поле должны привести нас к лучшему будущему. Однако реальность, как это часто бывает, рисует совершенно иную картину – мы с вами прямо сейчас движемся к катастрофе и возможному вымиранию.

Об этом свидетельствуют результаты сотен научных исследований. Недавно, например, был опубликован новый доклад МГЭИК, посвященный проблемам, связанным с изменением климата. Его результаты вторят результатам многочисленных научных работ, вывод из которых напрашивается неутешительный – нашей цивилизации осталось в лучшем случае 500 лет.

Но стремительно меняющийся климат, хотим мы этого или нет, не является единственной серьезной угрозой для человечества. И пока исследователи и эксперты со всего мира заняты решением проблем, вызванных глобальным потеплением, ряд ученых осмелился заглянуть в наше технологическое будущее. И нам действительно есть чего опасаться.

Что такое Искусственный интеллект?

Искусственный интеллект – это попытка создать компьютеры, способные к разумному поведению. По сути, это универсальный термин, используемый для обозначения всего – от Siri до IBM Watson и мощных технологий, которые нам еще предстоит изобрести.

Некоторые исследователи различают «узкий ИИ» или слабый ИИ — компьютерные системы, которые лучше людей в какой-то конкретной, четко определенной области, такой как игра в шахматы, генерация изображений или диагностика рака, — и «общий ИИ» – то есть, системы, которые могут превзойти человеческие возможности во многих областях. На сегодняшний день общего ИИ у нас нет, однако исследователи все лучше начинают осознавать проблемы, который он может собой представлять.

Технологии по распознаванию лиц становятся лучше с каждым годом

За последние несколько лет узкий ИИ добился необычайного прогресса: сегодня системы искусственного интеллекта отлично справляются с переводом иностранной речи, с игрой в шахматы и Го, а также в помогают решать важные вопросы исследовательской биологии, например предсказание того, как сворачиваются белки, и при создании изображений.

Более того, системы искусственного интеллекта определяют, что именно мы увидим в поиске Google или Яндекс или в ленте новостей Facebook или Вконтакте. Они сочиняют музыку и пишут статьи, которые на первый взгляд не отличаются от написанных человеком текстов. Эти же системы разрабатываются для улучшения наведения беспилотных летательных аппаратов и обнаружения ракет.

Но узкий ИИ становится все менее… слабым. На сегодняшний день ученым удалось добиться значительного прогресса в области искусственного интеллекта, кропотливо обучая компьютерные системы конкретным концепциям. И в последние годы интерес многих ученых нацелен на создание компьютерных систем, способных к обучению.

В целом, прогресс в области искусственного интеллекта позволил ученым добиться огромных успехов, а также поднял насущные этические вопросы. Так, Рози Кэмпбелл из Центра ИИ при Калифорнийском университете в Беркли утверждает, что нынешние трудности никак не связаны с теми жуткими сценариями из фильмов о восстании машин. Скорее, они возникают из-за несоответствия между тем, что мы приказываем нашим системам делать, и тем, что мы на самом деле от них хотим.

Искусственный интеллект несет в себе как прогресс, так и риск возможного регресса и гибели цивилизации

Проблемы, однако, возникают из-за того, что системы действительно хороши в достижении поставленной (или заданной) цели; но цель, которую они усвоили в своей учебной среде – это не тот результат, которого ученые на самом деле хотели добиться.

«В результате мы создаем системы, которые не понимаем, а это означает, что мы не всегда можем предвидеть их поведение», – отмечают исследователи.